目錄:北京津發(fā)科技股份有限公司>>ErgoLAB人機(jī)環(huán)境同步>>人機(jī)環(huán)境同步云平臺(tái)>> ErgoLABErgoLAB人機(jī)環(huán)境同步云平臺(tái)

| 參考價(jià) | 面議 |

| 參考價(jià) | 面議 |

更新時(shí)間:2025-03-12 15:51:06瀏覽次數(shù):22435評(píng)價(jià)

聯(lián)系我們時(shí)請(qǐng)說(shuō)明是化工儀器網(wǎng)上看到的信息,,謝謝!

| 產(chǎn)地類(lèi)別 | 國(guó)產(chǎn) | 應(yīng)用領(lǐng)域 | 道路/軌道/船舶,航空航天,公安/司法,汽車(chē)及零部件,綜合 |

|---|

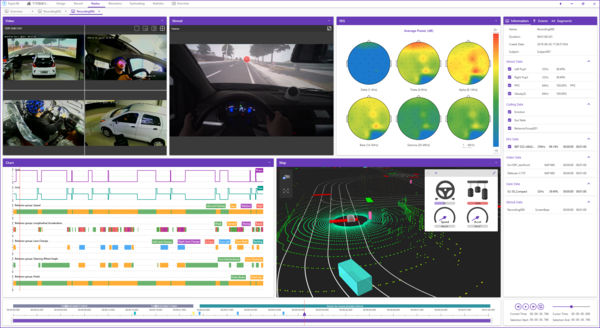

ErgoLAB人機(jī)環(huán)境同步云平臺(tái),,是集科學(xué)化,、集成化、智能化于一體的系統(tǒng)工程工具與解決方案產(chǎn)品,,可以與人,、機(jī)器、環(huán)境數(shù)據(jù)進(jìn)行同步采集與綜合人機(jī)工效分析,;尤其是人工智能時(shí)代根據(jù)人-信息-物理系統(tǒng)(HCPS)理論,,對(duì)人-機(jī)-環(huán)境系統(tǒng)從人-信息系統(tǒng),人-物理系統(tǒng)以及系統(tǒng)整體分別進(jìn)行人機(jī)交互評(píng)估以及人因與工效學(xué)的智能評(píng)價(jià),。

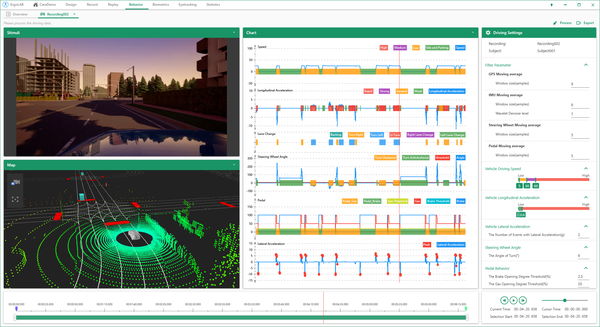

智能化人機(jī)環(huán)境測(cè)試云平臺(tái)支持科研項(xiàng)目的整個(gè)工作流程,,從基于云端的項(xiàng)目管理、實(shí)驗(yàn)設(shè)計(jì),、數(shù)據(jù)同步采集,、信號(hào)處理與數(shù)據(jù)分析到綜合統(tǒng)計(jì)與輸出可視化報(bào)告,,對(duì)于特殊領(lǐng)域客戶可定制云端的人因大數(shù)據(jù)采集與AI狀態(tài)識(shí)別,。具備ErgoVR虛擬現(xiàn)實(shí)實(shí)時(shí)同步人因工程研究解決方案、ErgoAI智能駕駛模擬實(shí)時(shí)同步人因工程研究解決方案,、ErgoSIM環(huán)境模擬實(shí)時(shí)同步人因工程研究解決方案,,可以在不同的實(shí)驗(yàn)環(huán)境為人-機(jī)-環(huán)境研究的發(fā)展提供進(jìn)一步的主客觀數(shù)據(jù)支撐與科學(xué)指導(dǎo)。

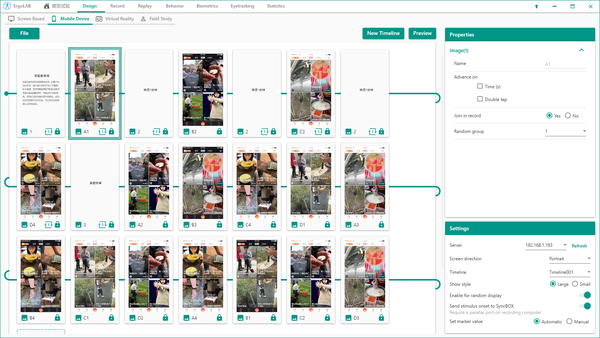

其中,,云實(shí)驗(yàn)設(shè)計(jì)模塊具備多時(shí)間軸,、隨機(jī)化呈現(xiàn)等功能、可以創(chuàng)建復(fù)雜的實(shí)驗(yàn)刺激,,支持任何類(lèi)型的刺激材料,,包括自定義問(wèn)卷、量表與實(shí)驗(yàn)范式(系統(tǒng)包含常用量表與實(shí)驗(yàn)范式以及數(shù)據(jù)常模,,如NASA-TLX認(rèn)知負(fù)荷量表、PANAS情緒效價(jià)量表,、Stroop任務(wù),、MOT多目標(biāo)追蹤,、注意力訓(xùn)練任務(wù)等)、聲光電刺激與實(shí)時(shí)API行為編碼/TTL事件標(biāo)記,、多媒體刺激編輯如文本、聲音,、圖像,視頻(含360度圖片和視頻),,在線網(wǎng)站和手機(jī)應(yīng)用程序,,以及所有的原型設(shè)計(jì)材料,也支持與如下刺激實(shí)時(shí)同步采集:如場(chǎng)景攝像機(jī),、軟件,,游戲,VR,,AR程序等。兼容第三方軟件刺激編譯軟件,,如E-prime,,Superlab,,TobiiPro Lab等,。

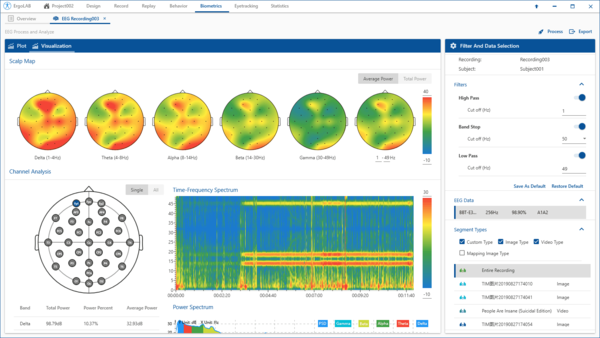

ErgoLAB人機(jī)環(huán)境同步云平臺(tái)采用主客觀結(jié)合多維度數(shù)據(jù)驗(yàn)證的方法,數(shù)據(jù)同步種類(lèi)包含大腦認(rèn)知數(shù)據(jù)(EEG腦機(jī)交互與腦電測(cè)量系統(tǒng),、fNIRS高密度近紅外腦功能成像系統(tǒng)),,視覺(jué)數(shù)據(jù)(Eyetracking視線交互與眼動(dòng)追蹤系統(tǒng)),生理信號(hào)數(shù)據(jù)(生理儀含:GSR/EDA,、EMG,、ECG、EOG,、HRV,、RESP、TEMP/SKT,、PPG,、SpO2),行為觀察,、肢體動(dòng)作與面部表情(基本情緒,、情緒效價(jià)、微表情等)數(shù)據(jù),、生物力學(xué)數(shù)據(jù)(拉力,、握力、捏力、壓力…),,人機(jī)交互數(shù)據(jù)(包含如網(wǎng)頁(yè)終端界面交互行為數(shù)據(jù)以及對(duì)應(yīng)的鍵盤(pán)操作,,鼠標(biāo)點(diǎn)擊、懸浮,、劃入劃出等,;移動(dòng)終端界面交互行為數(shù)據(jù)以及對(duì)應(yīng)的手指行為如點(diǎn)擊、縮放,、滑動(dòng)等,;VR終端界面人機(jī)交互行為數(shù)據(jù)及對(duì)應(yīng)的雙手操作拾取、丟棄,、控制,,VR空間行走軌跡)、以及多類(lèi)型時(shí)空行為數(shù)據(jù)采集(包括室內(nèi),、戶外,、以及VR環(huán)境不同時(shí)空的行走軌跡、行車(chē)軌跡,、訪問(wèn)狀態(tài)以及視線交互,、情感反應(yīng)、交互操作行為等數(shù)據(jù)采集),、以及環(huán)境數(shù)據(jù)(溫度,、濕度、噪音,、光照,、大氣壓、濕度,、粉塵等)等客觀量化數(shù)據(jù),。

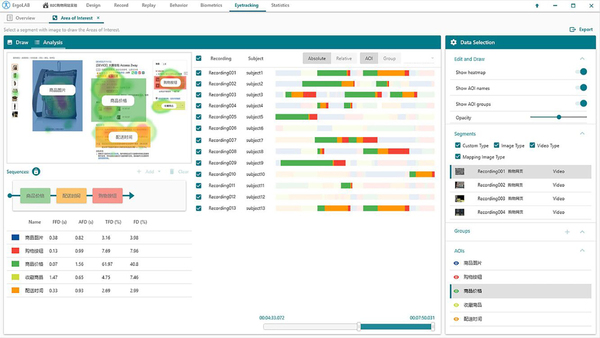

ErgoLAB人機(jī)環(huán)境同步云平臺(tái)包含強(qiáng)大的數(shù)據(jù)分析模塊以及廣泛的認(rèn)知和情感生物特征識(shí)別(如記憶,注意力,,情緒反應(yīng),,行為決策,以及警覺(jué),、壓力等),。ErgoLAB數(shù)據(jù)分析與綜合統(tǒng)計(jì)分析模塊包含多維度人-機(jī)-環(huán)境數(shù)據(jù)綜合分析、EEG腦電分析與可視化,、眼動(dòng)分析與可視化,、行為觀察分析、面部表情分析,、動(dòng)作姿態(tài)傷害評(píng)估與工效學(xué)分析,、交互行為分析,、時(shí)空行為分析、車(chē)輛與駕駛行為分析(ErgoAI駕駛版本),、HRV心率變異性分析,、EDA/GSR皮電分析、RESP呼吸分析,、EMG肌電分析,、General通用信號(hào)分析(如SKT皮溫分析、EOG眼電分析以及其他環(huán)境與生物力學(xué)信號(hào)分析),。系統(tǒng)具備專門(mén)的信號(hào)處理模塊以及開(kāi)放式信號(hào)處理接口,,可以直接導(dǎo)出可視化分析報(bào)告以及原始數(shù)據(jù),支持第三方處理與開(kāi)發(fā),。

津發(fā)科技提供定制開(kāi)發(fā)服務(wù),,與人因工程與工效學(xué)分析評(píng)價(jià)領(lǐng)域相關(guān)的算法模型、軟硬件產(chǎn)品與技術(shù)可深入研發(fā),,詳情咨詢津發(fā)科技,!

ErgoLAB人機(jī)環(huán)境同步云平臺(tái),是集科學(xué)化,、集成化,、智能化于一體的系統(tǒng)工程工具與解決方案產(chǎn)品,可以與多種類(lèi)人,、機(jī)器,、環(huán)境數(shù)據(jù)進(jìn)行同步采集與綜合分析,尤其是人工智能時(shí)代根據(jù)人-信息-物理系統(tǒng)(HCPS)理論,,對(duì)人-機(jī)-環(huán)境系統(tǒng)從人-信息系統(tǒng),,人-物理系統(tǒng)以及系統(tǒng)整體分別進(jìn)行人機(jī)交互評(píng)估以及人因與工效學(xué)的智能評(píng)價(jià),。

智能云平臺(tái)系統(tǒng)支持項(xiàng)目的整個(gè)工作流程,,從基于云端的項(xiàng)目管理、試驗(yàn)設(shè)計(jì)(試驗(yàn)方法設(shè)置),、數(shù)據(jù)同步采集,、信號(hào)處理與數(shù)據(jù)分析到綜合統(tǒng)計(jì)與輸出可視化報(bào)告,以及云端的大數(shù)據(jù)采集與AI狀態(tài)識(shí)別,。具備ErgoVR虛擬現(xiàn)實(shí)解決方案實(shí)時(shí)同步模塊,、ErgoAI智能駕駛模擬解決方案實(shí)時(shí)同步模塊、ErgoSIM環(huán)境模擬解決方案實(shí)時(shí)同步模塊,,可以在不同的實(shí)驗(yàn)環(huán)境為人-機(jī)-環(huán)境研究的發(fā)展提供進(jìn)一步的主客觀數(shù)據(jù)支撐與科學(xué)指導(dǎo),。

其中,云試驗(yàn)設(shè)計(jì)產(chǎn)品模塊,,可以進(jìn)行靈活的試驗(yàn)設(shè)計(jì),,支持任何類(lèi)型的刺激材料,包括自定義問(wèn)卷、量表與實(shí)驗(yàn)范式(系統(tǒng)打包大量常用量表與實(shí)驗(yàn)范式以及數(shù)據(jù)常模,,如NASA-TLX認(rèn)知負(fù)荷量表,、PANAS情緒效價(jià)量表、Stroop任務(wù),、MOT多目標(biāo)追蹤,、注意力訓(xùn)練任務(wù)等)、聲光電刺激與實(shí)時(shí)API/TTL事件標(biāo)記,、多媒體刺激編輯如文本,、聲音、圖像,,視頻,,在線網(wǎng)站和手機(jī)應(yīng)用程序,以及所有的原型設(shè)計(jì)材料,,也支持與如下刺激實(shí)時(shí)同步采集:場(chǎng)景攝像機(jī),、軟件,游戲,,VR,,AR程序等。兼容第三方軟件刺激,,如Eprime,,Tobii Pro Lab等。

ErgoLAB人機(jī)環(huán)境同步云平臺(tái)采用主客觀結(jié)合多維度數(shù)據(jù)驗(yàn)證的方法,,可用于云項(xiàng)目管理,、云實(shí)驗(yàn)設(shè)計(jì)、同步采集,、綜合統(tǒng)計(jì)分析與可視化等全流程科研應(yīng)用,,數(shù)據(jù)同步種類(lèi)包含大腦認(rèn)知數(shù)據(jù)(EEG腦機(jī)交互與腦電測(cè)量系統(tǒng)、fNIRS高密度近紅外腦功能成像系統(tǒng)),,視覺(jué)數(shù)據(jù)(Eyetracking視線交互與眼動(dòng)追蹤系統(tǒng)),,生理信號(hào)(GSR/EDA、EMG,、ECG,、EOG、HRV,、RESP,、TEMP/SKT、PPG,、SpO2),,行為觀察,、肢體動(dòng)作與面部表情(基本情緒、情緒效價(jià),、微表情等)數(shù)據(jù),、生物力學(xué)數(shù)據(jù)(拉力、握力,、捏力,、壓力),人機(jī)交互數(shù)據(jù)(包含如網(wǎng)頁(yè)終端界面交互行為數(shù)據(jù)以及對(duì)應(yīng)的鍵盤(pán)操作,,鼠標(biāo)點(diǎn)擊,、懸浮、劃入劃出等,;移動(dòng)終端界面交互行為數(shù)據(jù)以及對(duì)應(yīng)的手指行為如點(diǎn)擊,、縮放、滑動(dòng)等,;VR終端界面人機(jī)交互行為數(shù)據(jù)及對(duì)應(yīng)的雙手操作拾取,、丟棄、控制,,VR空間行走軌跡),、以及多類(lèi)型時(shí)空數(shù)據(jù)采集(包括室內(nèi)、戶外,、以及VR環(huán)境不同時(shí)空的行走軌跡,、訪問(wèn)狀態(tài)以及視線交互、情感反應(yīng),、交互操作行為等數(shù)據(jù)采集),、以及環(huán)境數(shù)據(jù)(溫度、濕度,、噪音,、光照、大氣壓,、濕度,、粉塵等)等客觀量化數(shù)據(jù),。

ErgoLAB人機(jī)環(huán)境同步云平臺(tái)包含強(qiáng)大的數(shù)據(jù)分析模塊以及廣泛的認(rèn)知和情感生物特征識(shí)別(如記憶,,注意力,情緒反應(yīng),,行為決策,,以及警覺(jué)、壓力等),。ErgoLAB數(shù)據(jù)分析與綜合統(tǒng)計(jì)分析模塊包含多維度人-機(jī)-環(huán)境數(shù)據(jù)綜合分析,、EEG腦電分析與可視化,、眼動(dòng)分析與可視化、行為觀察分析,、面部表情分析,、動(dòng)作姿態(tài)傷害評(píng)估與工效學(xué)分析、交互行為分析,、時(shí)空行為分析,、車(chē)輛與駕駛行為分析(ErgoAI駕駛版本)、HRV心率變異性分析,、EDA/GSR皮電分析,、RESP呼吸分析、EMG肌電分析,、General通用信號(hào)分析(如SKT皮溫分析,、EOG眼電分析以及其他環(huán)境與生物力學(xué)信號(hào)分析)。系統(tǒng)具備專門(mén)的信號(hào)處理模塊以及開(kāi)放式信號(hào)處理接口,,可以直接導(dǎo)出可視化分析報(bào)告以及原始數(shù)據(jù),,支持第三方處理與開(kāi)發(fā)。

通過(guò)ErgoLAB人機(jī)環(huán)境同步云平臺(tái)可以與更多種類(lèi)的數(shù)據(jù)進(jìn)行同步,,可用于云項(xiàng)目管理,、云實(shí)驗(yàn)設(shè)計(jì)、同步采集,、綜合統(tǒng)計(jì)分析與可視化等全流程科研應(yīng)用,,實(shí)驗(yàn)設(shè)計(jì)云平臺(tái)模塊可以進(jìn)行自定義問(wèn)卷設(shè)計(jì)、聲光電刺激與實(shí)時(shí)事件標(biāo)記,、多媒體刺激編輯如文本,、聲音、圖像,,視頻,,實(shí)時(shí)網(wǎng)站和手機(jī)應(yīng)用程序的原型設(shè)計(jì)文件,也支持與如下刺激實(shí)時(shí)同步采集:場(chǎng)景攝像機(jī),、軟件,,游戲,VR,,AR程序等,;并且具備ErgoVR虛擬現(xiàn)實(shí)解決方案實(shí)時(shí)同步模塊、ErgoAI智能駕駛模擬解決方案實(shí)時(shí)同步模塊,、ErgoSIM環(huán)境模擬解決方案實(shí)時(shí)同步模塊,,可以在不同的實(shí)驗(yàn)環(huán)境為人-機(jī)-環(huán)境研究的發(fā)展提供了進(jìn)一步的主客觀數(shù)據(jù)支撐。

ErgoLAB人機(jī)環(huán)境測(cè)試云平臺(tái)將主觀問(wèn)卷與客觀數(shù)據(jù)集成,,可用于云項(xiàng)目管理,、云實(shí)驗(yàn)設(shè)計(jì),、同步采集、綜合統(tǒng)計(jì)分析與可視化等全流程科研應(yīng)用,,數(shù)據(jù)同步種類(lèi)包含大腦認(rèn)知數(shù)據(jù)(EEG腦機(jī)交互與腦電測(cè)量系統(tǒng),、fNIRS高密度近紅外腦功能成像系統(tǒng)),視覺(jué)數(shù)據(jù)(Eyetracking視線交互與眼動(dòng)追蹤系統(tǒng)),,生理信號(hào)(GSR/EDA,、EMG、ECG,、EOG,、HRV、RESP,、TEMP/SKT,、PPG、SpO2,,行為觀察,、肢體動(dòng)作與面部表情、生物力學(xué)(拉力,、握力,、捏力、壓力),,人機(jī)交互數(shù)據(jù)(包含如網(wǎng)頁(yè)終端界面交互行為數(shù)據(jù)以及對(duì)應(yīng)的鍵盤(pán)操作,,鼠標(biāo)點(diǎn)擊、懸浮,、劃入劃出等,;移動(dòng)終端界面交互行為數(shù)據(jù)以及對(duì)應(yīng)的手指行為如點(diǎn)擊、縮放,、滑動(dòng)等,;VR終端界面人機(jī)交互行為數(shù)據(jù)及對(duì)應(yīng)的雙手操作拾取、丟棄,、控制,,VR空間行走軌跡)等客觀量化數(shù)據(jù)。

ErgoLAB綜合統(tǒng)計(jì)分析功能包含人機(jī)環(huán)境數(shù)據(jù)綜合分析,、EEG腦電分析與可視化,、眼動(dòng)分析與可視化、行為觀察分析,、面部表情分析,、動(dòng)作姿態(tài)傷害評(píng)估與工效學(xué)分析、交互行為分析,、時(shí)空行為分析,、車(chē)輛分析(ErgoAI駕駛版本)、HRV心率變異性分析,、EDA皮電分析,、RESP呼吸分析、EMG肌電分析,、General通用信號(hào)分析,。津發(fā)科技提供定制開(kāi)發(fā)服務(wù),與人因工程與工效學(xué)分析評(píng)價(jià)領(lǐng)域相關(guān)的算法模型,、軟硬件產(chǎn)品與技術(shù)可深入研發(fā),,詳情咨詢津發(fā)科技!

SennsLab是一種人類(lèi)行為研究軟件工具,,可 無(wú)縫同步35種以上傳感器模式的研究設(shè)計(jì)和數(shù)據(jù)收集,。它支持項(xiàng)目的整個(gè)工作流程,從實(shí)驗(yàn)方法設(shè)置到數(shù)據(jù)收集和導(dǎo)出以進(jìn)行完整的分析,。

毫秒級(jí)同步,,您將能夠從各種傳感器模式(GSR,ECG,,EEG,,EMG,EEG,,眼睛跟蹤...)以及多種刺激(照片,,視頻,自由任務(wù),, VR體驗(yàn),,網(wǎng)站...)具有出色的時(shí)間表現(xiàn)。因此,,您將能夠輕松,,準(zhǔn)確地分析來(lái)自Excel,SPSS,,MatLab等的數(shù)據(jù),。

SennsMetrics是SennsLab軟件的擴(kuò)展,可提供十分常用的研究設(shè)計(jì)模板,,強(qiáng)大的數(shù)據(jù)分析平臺(tái)以及廣泛的認(rèn)知和情感生物特征識(shí)別(例如記憶,,注意力,情感價(jià),,激活和影響,,參與度等) )。SennsMetrics是為那些希望在生理數(shù)據(jù)解碼和分析方面向前邁進(jìn)的人而特別設(shè)計(jì)的,,它提供了一種實(shí)用且可行的解決方案,。

干腦電圖 半干腦電圖 生物信號(hào) 室內(nèi)定位系統(tǒng) 眼動(dòng)追蹤

![]()

其他

任何類(lèi)型的刺激

圖像,,視頻,體驗(yàn),,網(wǎng)站,,應(yīng)用程序,VR / AR設(shè)置...

第三方軟件刺激

Eprime,,Tobii Pro Lab ...

兼容LabStreamLayer

BCI200,,OpenVie,NeuroPype ...

實(shí)時(shí)API

數(shù)據(jù)分析

原始數(shù)據(jù)到第三方

Matlab(EEGLAB,,BCILAB等)

Python(MNE等)

Neuroguide WE

其他

SennsMetrics 可選

Bitbrain軟件分析工具

情緒和認(rèn)知指標(biāo)

Excel導(dǎo)出(單個(gè)和匯總)

多媒體資料

技術(shù)指標(biāo)

| 人類(lèi)行為指標(biāo) | |

| 情緒生物識(shí)別 | 價(jià),,情緒激活,情緒影響 |

| 認(rèn)知生物識(shí)別 | 注意,,記憶,,參與。 |

| 行為指標(biāo) | 鼠標(biāo)跟蹤,,時(shí)間,。 |

| 眼動(dòng)追蹤指標(biāo) | 視覺(jué)注意,注視 |

| 內(nèi)隱動(dòng)機(jī)和行為 | 隱式聯(lián)想響應(yīng)測(cè)試(IAT和啟動(dòng)) |

| IPS指標(biāo) | 位置追蹤 |

| 指標(biāo)表示 | |

| 個(gè)人 | 對(duì)于生物識(shí)別,,時(shí)間和隱式關(guān)聯(lián):條形圖和統(tǒng)計(jì)差異表,。對(duì)于眼睛跟蹤,鼠標(biāo)定位和室內(nèi)定位:熱圖,,比率圖,,時(shí)間圖,軌跡圖,,感興趣的區(qū)域(*固定時(shí)間,,花費(fèi)的時(shí)間,比率,,重新訪問(wèn),,平均固定時(shí)間,以前的固定時(shí)間)和匯總的固定視頻,。 |

| 組合式 | 情感定位圖,,結(jié)合指標(biāo)的視頻,刺激,,攝像頭和麥克風(fēng)(匯總,,按細(xì)分或個(gè)人匯總)。 |

| 輸出格式 | |

| 檔案 | 所有CSV格式的生物特征識(shí)別(單獨(dú)和匯總),,與第三方工具(Matlab,,Excell等)兼容 |

| 可視化軟件 | Bitbrain生物識(shí)別可視化軟件。分析間隔和感興趣的區(qū)域。 |

| 多媒體資料 | 包含陳述和視頻以進(jìn)行報(bào)告,。 |

(空格分隔,最多3個(gè),單個(gè)標(biāo)簽最多10個(gè)字符)